Contents

具体的には何をやっているの?

どうやって投影するの?どうやって作っているの?

お答えできる範囲でお答えします🦌🐾

1年間の活動映像

1年間の活動のまとめ映像です👀ぜひご覧ください!

また、現在Web上で擬似体験をできるよう準備を進めております!公開まで今しばらくお待ちください!

私たちが作ったシナリオの全集と、キャラクター設定集を公開しております👀

ぜひご覧ください!

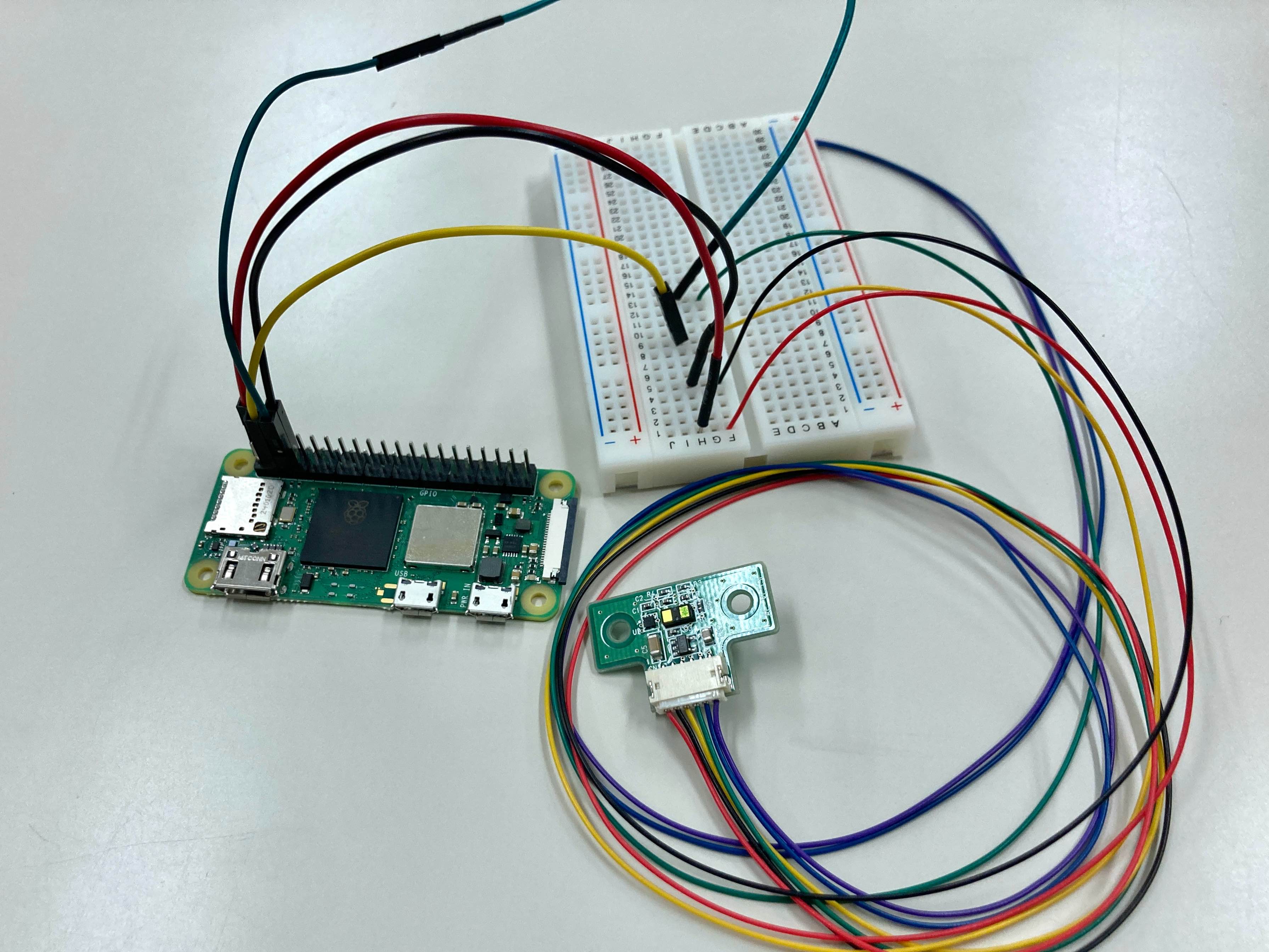

システムの基盤

プログラミング班が担当しています。

Unity、Flask、Raspberry PiとGoogleスプレッドシートを用いてシステムを実装しています。

Unityでは映像投影とシーンの切り替え、FlaskではIDとユーザ情報を取得したりセンサ起動合図を送るためのWebシステムの構築、

Raspberry Piではセンサが読み取った値を元に、体験者の行動を検知しています。

そしてそれらの情報はすべてスプレッドシートによって管理されています。

Unity

十を超える映像制御と投影、ブース毎のプログラムを作成しています。

スプレッドシートから体験者がブースに来たことや分岐点でどのような行動をしたのかを読み取っています。また、映像が始まった時刻や、センサ起動合図を書き込むこともしています。

Flask

体験の際にアクセスしていただくWebアプリサイトを作成しています。

ユーザ名・IDの登録、字幕ログの表示、Unityと同じくセンサ起動合図など様々なことを行っています。ユーザの案内機能に加えて、センサーやUnityを裏側で繋げる役割をしています。

距離センサ

AE-VL53L1Xという赤外線距離センサを利用しています。

2つ目のブースで、どちらの森を選択したのかを読み取るときにこのセンサが動いています。赤外線を出し、物体とぶつかって赤外線が跳ね返ってくるまでの時間によってどれだけ離れているのかを検知しています。

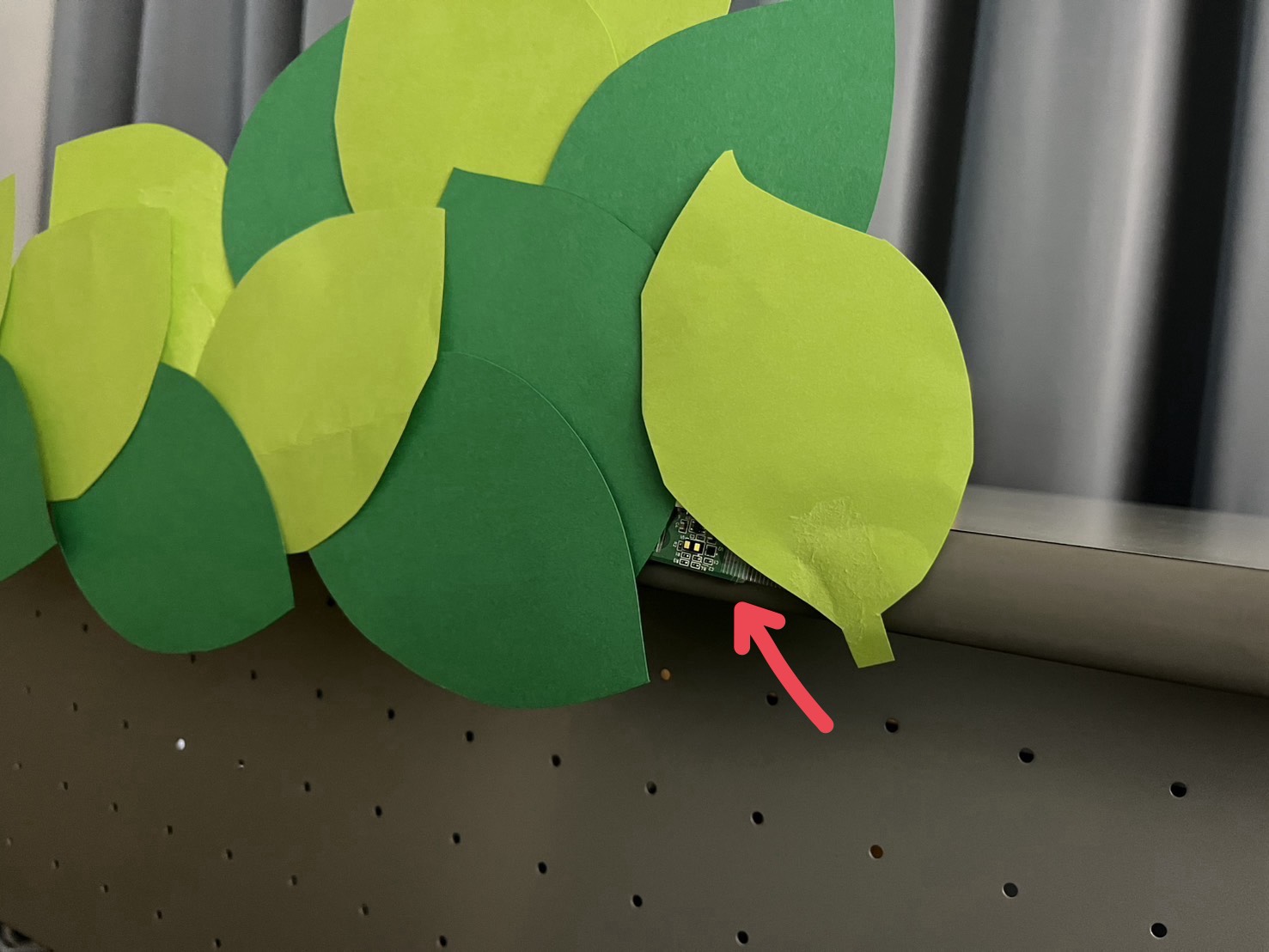

赤外線を出しているところ、その跳ね返りを受け取るところ以外の部分は下の写真のように葉っぱの装飾をしています。最終発表ではどのように隠されているのか探しに来てくださいね👀

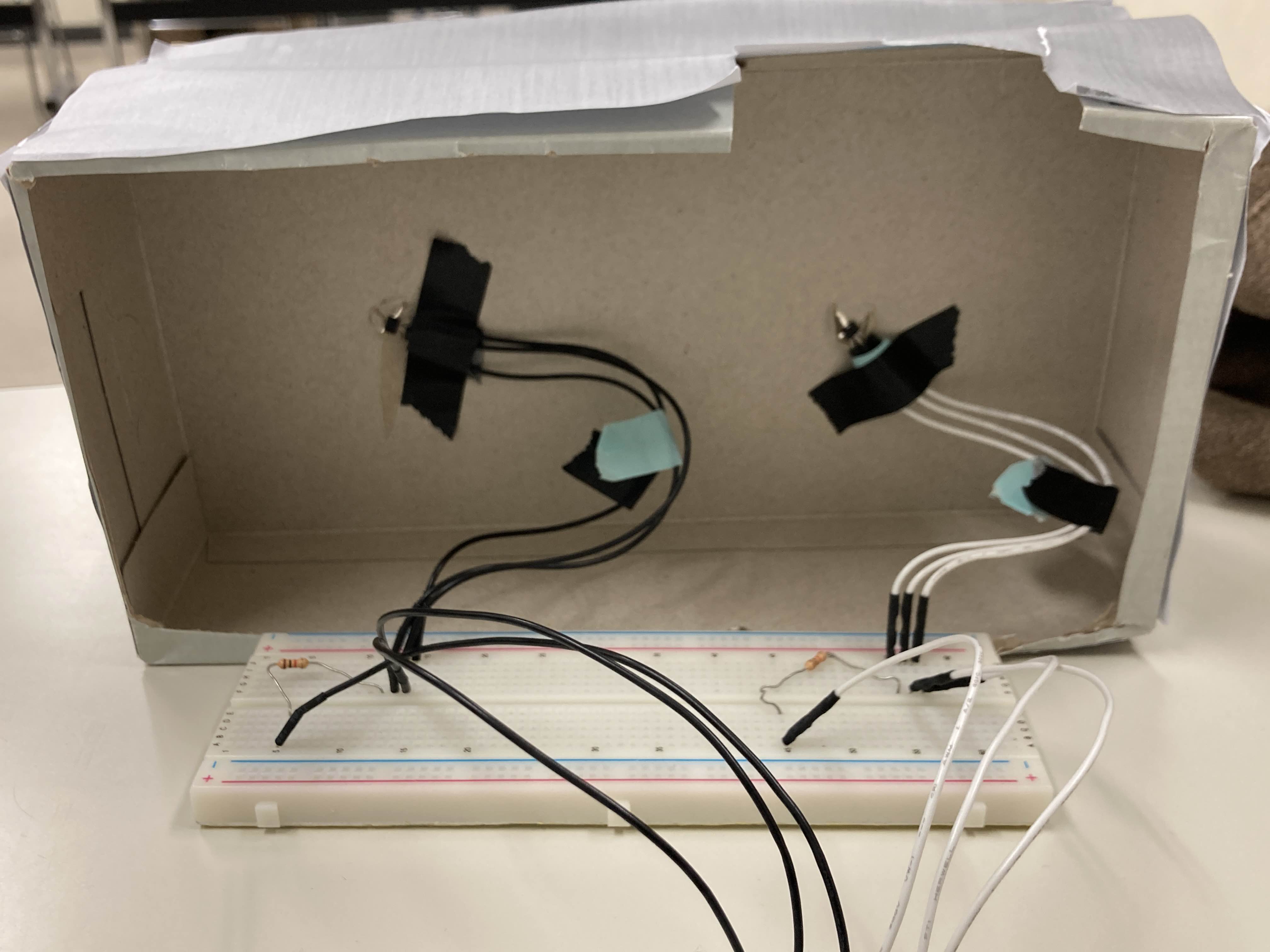

ホールセンサ

SK8552G-G03というホールセンサを使っています。磁気を検知するセンサです。

右側の白いコードの先にある、黒くて四角いのがホールセンサです。左側にもあるので、2つを同時に動かしています。

1つ目のポーション選択の時に使っています。ポーションの底には磁石が入っており、ホールセンサはその磁石の磁気を読み取って体験者がどのポーションを取ったのかを判別しています。

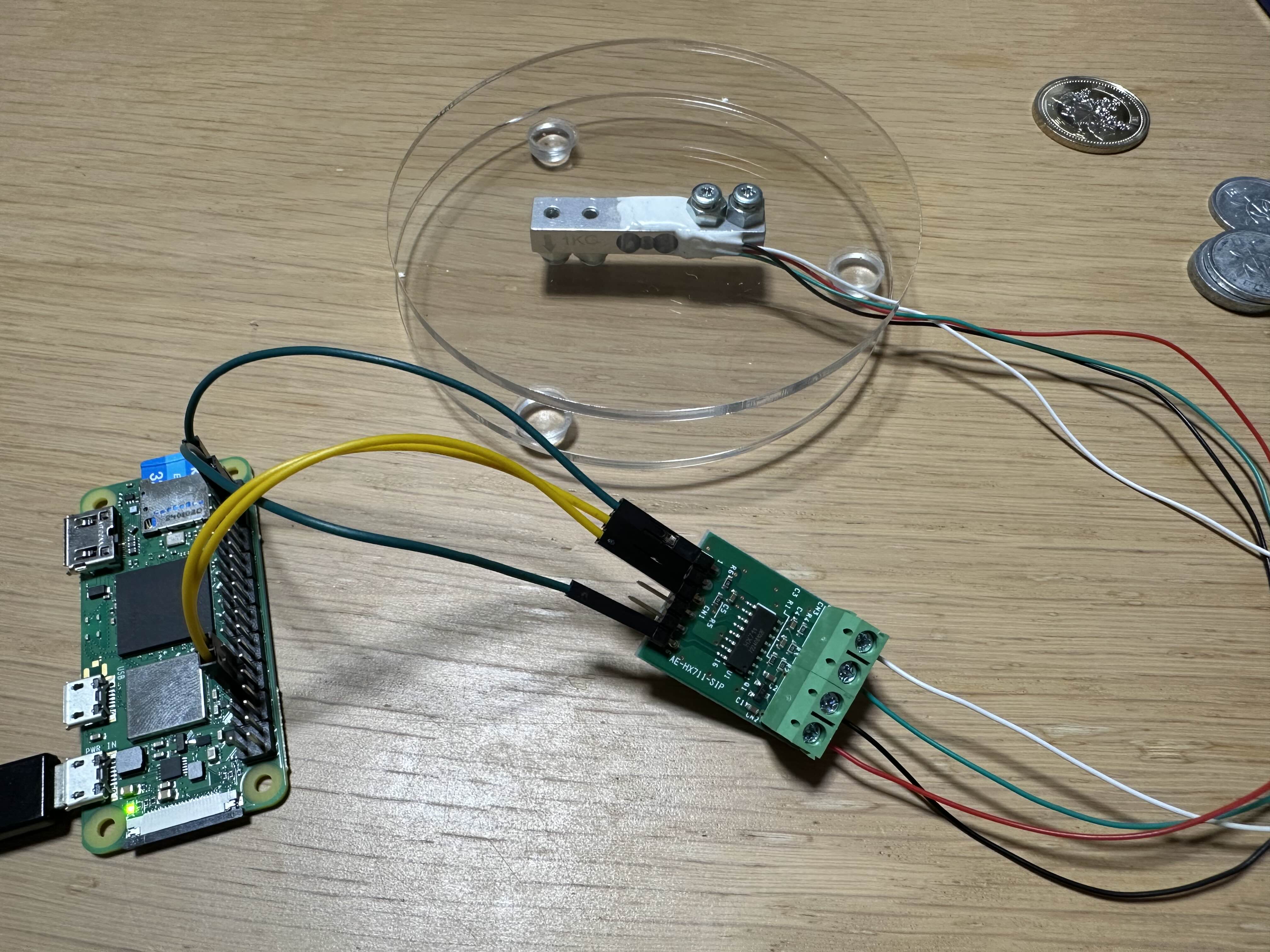

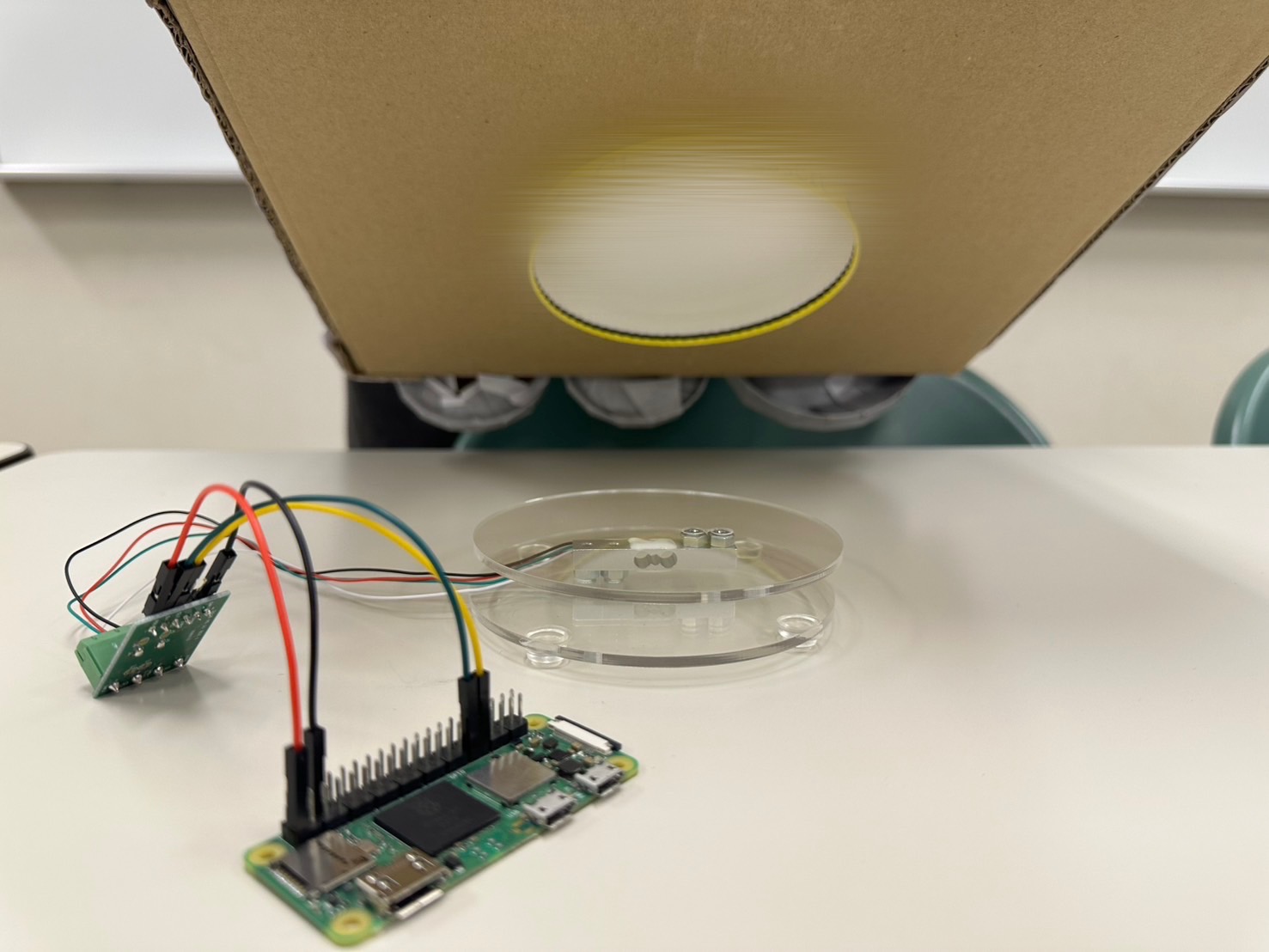

重量センサ

SC616Cという重量センサと、この重量センサを動かすためにAE-HX711-SIPというコンバータを使っています。

3つ目のブース、鉱山エリアでは体験者が採掘した鉱石をトロッコに積み込むと、トロッコの下に設置している重量センサが積み込まれた鉱石の重さを正確に計測します。

計測された重さは設定された基準値と比較され、基準重量以上か以下かによって物語の分岐が決まる仕組みになっています。

デザイン・映像

デザイン班が担当しています。

白雪姫のデザインをはじめ、実際に投影している映像作成を行います。

キャラクターデザイン、各パーツを動かすための骨格作りであるモデリング、リアルな動きを作るアニメーション、そしてそれを元に作成する映像と、幅広く作業をしています。

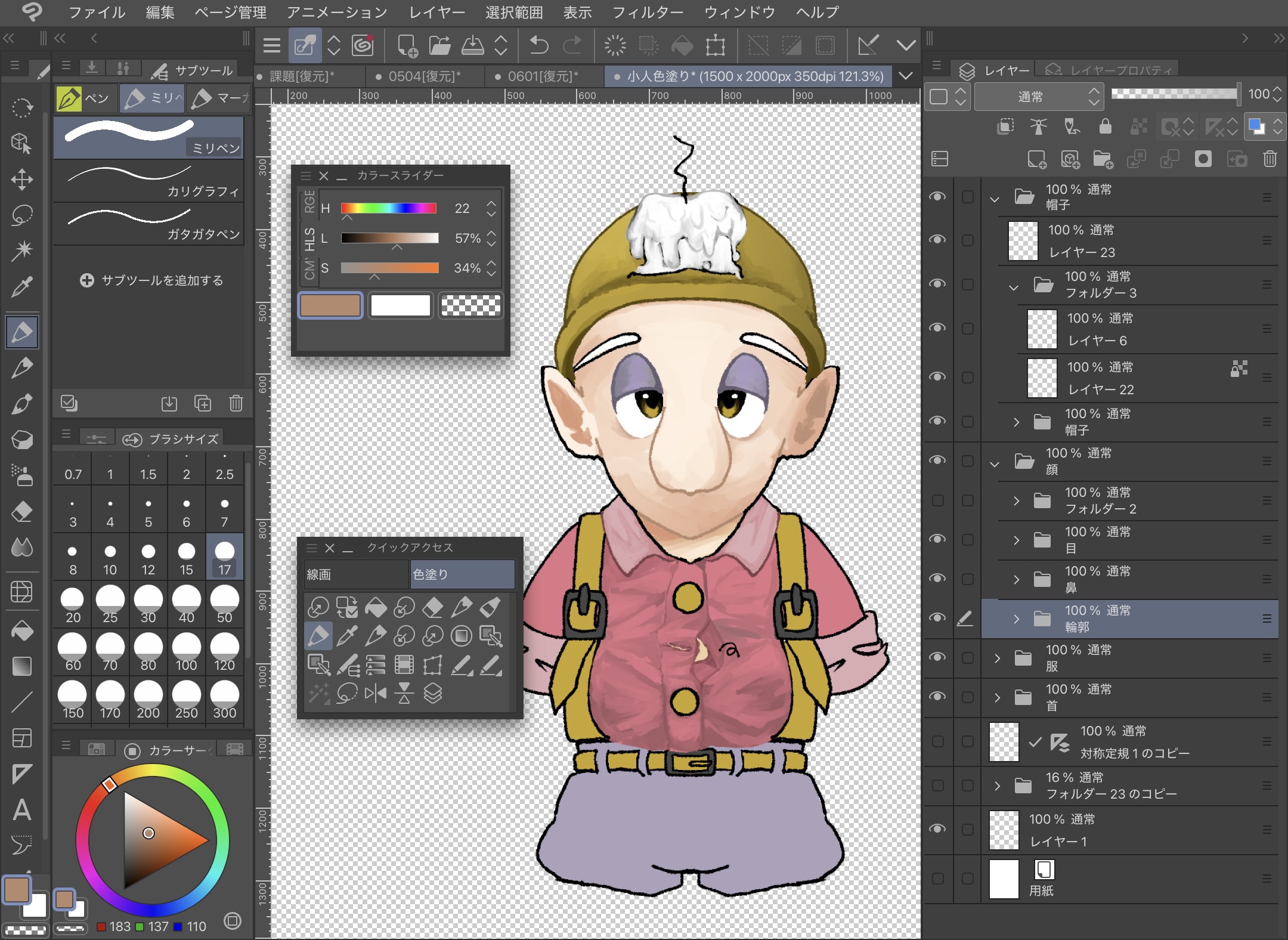

キャラクターデザイン

登場するすべてのキャラクターは、!が描いています✍️

白雪姫、小人、王子、魔女などそれぞれのキャラクターごとに設定やキーワードがあり、それを基にそれぞれのキャラクターを仕上げています。

それぞれのキャラクターの設定集は別途作成し、最終発表の際に読むことができるよう準備を進めているのでぜひ見に来てください👀

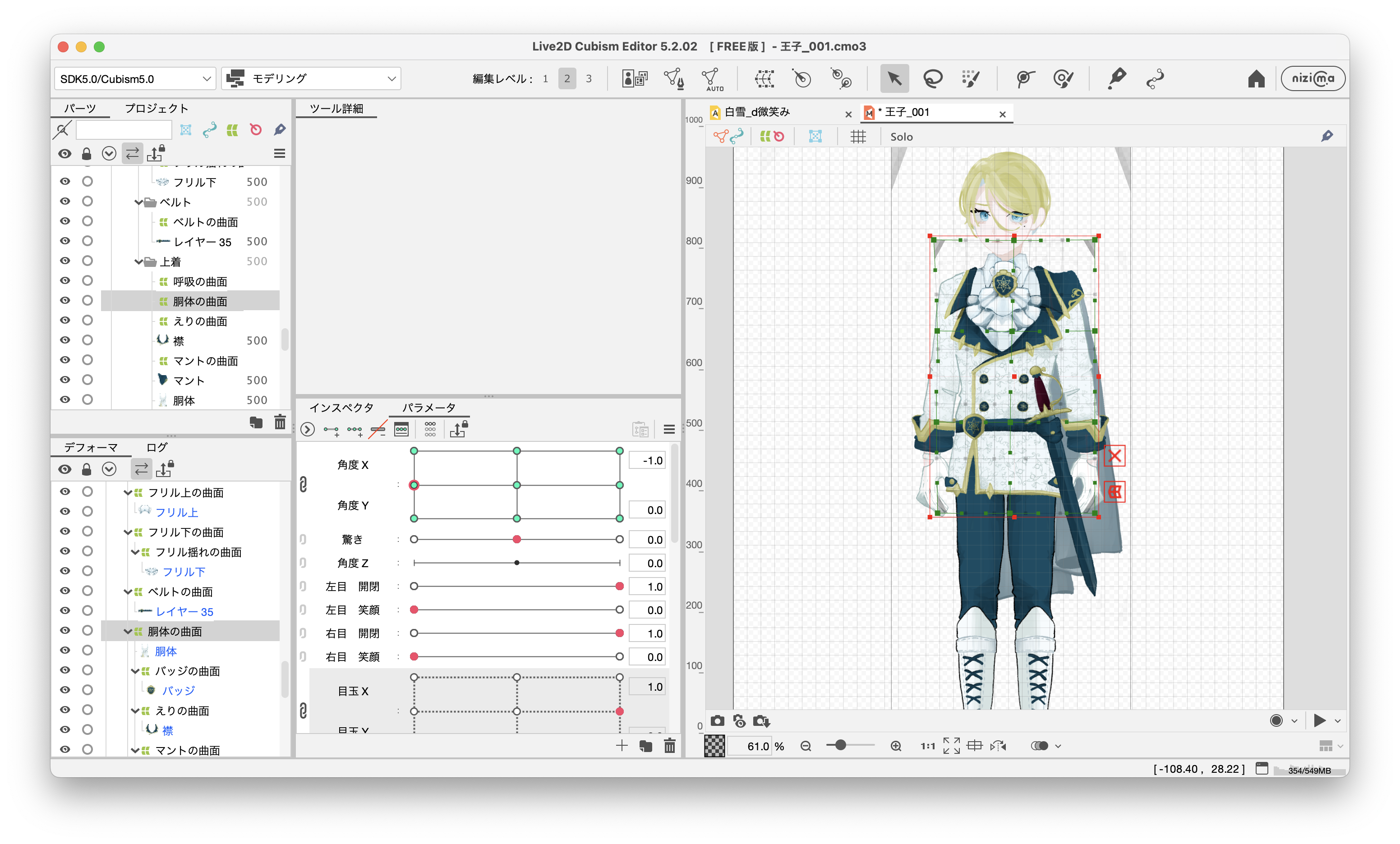

モデリング

Live2D Cubsimというツールを使用しています。この後のアニメーションのために必要な作業で、パーツ分けや骨組みを作るための工程です。

目や口、髪などのレイヤーごとにパーツ分けをした後に、モデリングとしてアートメッシュ作成、デフォーマ作成、パラメータ設計をしています。

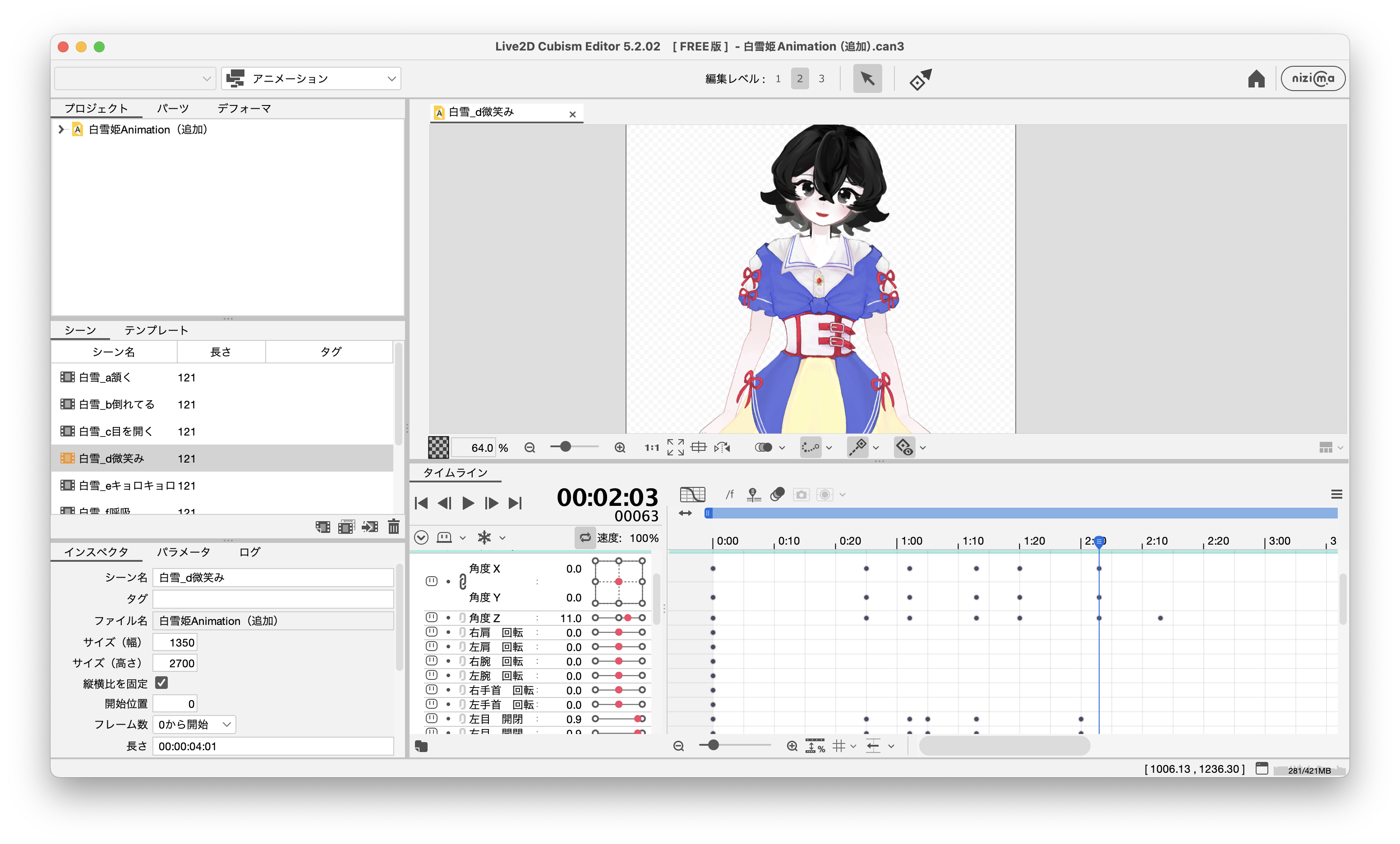

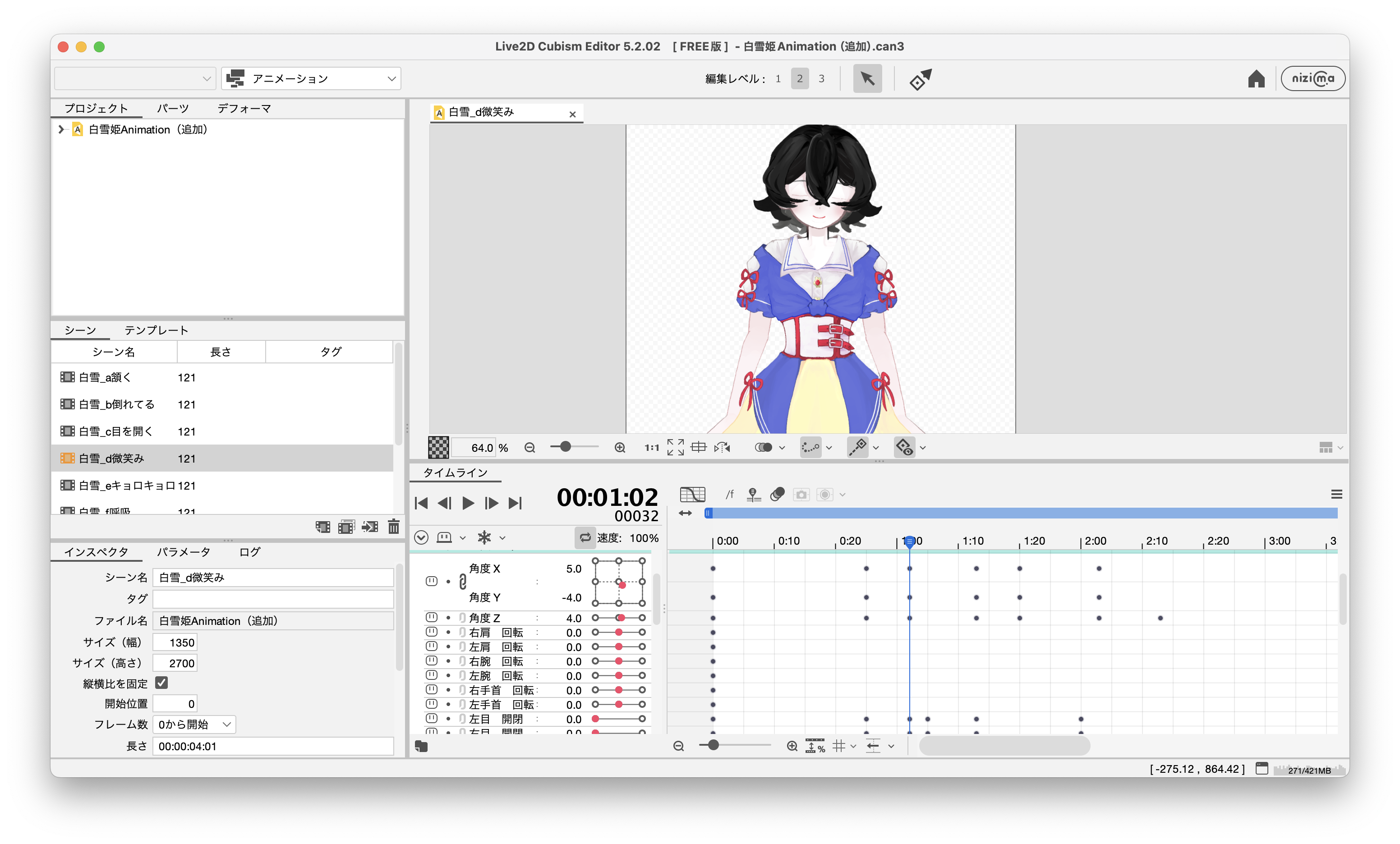

アニメーション

モデリングと同じく、Live2D Cubsimというツールを使用しています。モデリングをしたキャラクターに対して表情や動きを加え、キャラクターが息づくようアニメーションを作成します。

動作の合間に一瞬まぶたを閉じることで生き生きとした印象を与えたり、動き出しや止まる直前にわずかな“逆方向の揺れ”を加えることで、リアルな慣性を表現したりしています。

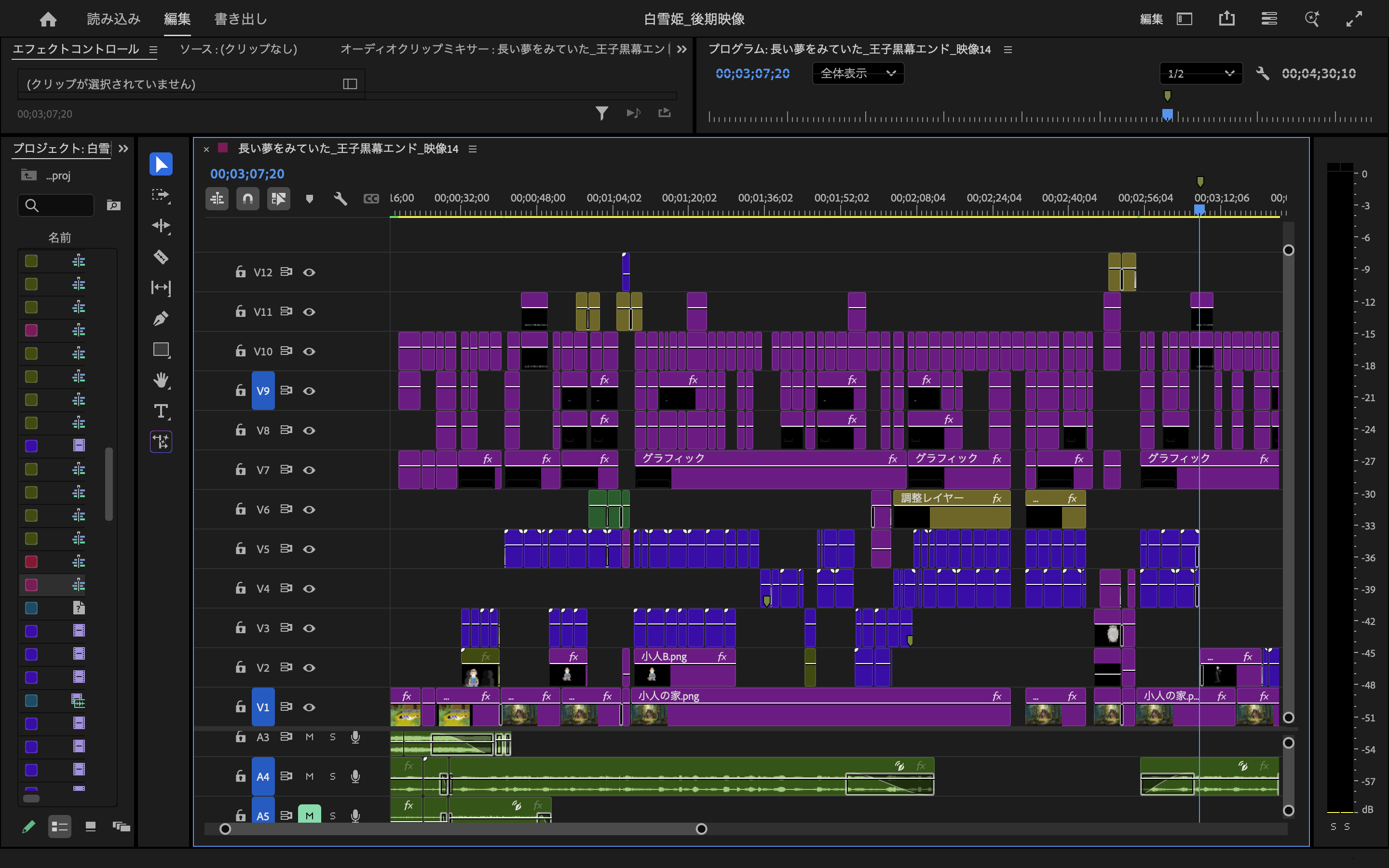

映像

アニメーションで作成した素材を基盤に映像の最終的な形を創り上げます。

アニメーションと背景、テロップを組み合わせ、没入できる映像作成を行なっています。